«Τα μοντέλα τεχνητής νοημοσύνης μπορούν να χακαριστούν», σύμφωνα με «γκουρού» της τεχνολογίας

Ο πρώην διευθύνων σύμβουλος της Google προειδοποιεί για τους κινδύνους της τεχνητής νοημοσύνης

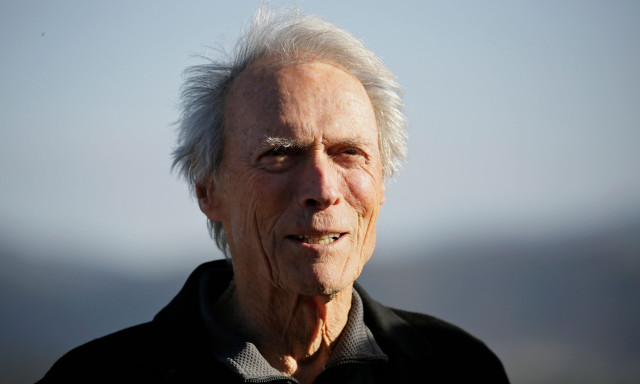

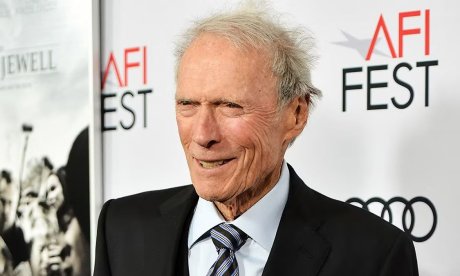

Ο Έρικ Σμιντ, πρώην διευθύνων σύμβουλος της Google.

Ο Έρικ Σμιντ, που διετέλεσε διευθύνων σύμβουλος της Google την περίοδο 2001 – 2011, εξέφρασε έντονες ανησυχίες για τους πιθανούς κινδύνους της τεχνητής νοημοσύνης, αναφερόμενος στις «επικίνδυνες χρήσεις» της, σε τοποθέτηση στο πλαίσιο συζήτησης κατά τη διάρκεια του Sifted Summit.

«Υπάρχει πιθανότητα η εξάπλωση της τεχνητής νοημοσύνης να αποτελέσει πρόβλημα; Αναμφίβολα, Οι βασικοί κίνδυνοι σχετίζονται με το ενδεχόμενο η τεχνολογία αυτή να βρεθεί σε λάθος χέρια και να αξιοποιηθεί με κακόβουλο ή καταχρηστικό τρόπο»», τόνισε.

Σύμφωνα με τον Σμιντ, υπάρχουν σαφείς ενδείξεις ότι μοντέλα τεχνητής νοημοσύνης –είτε ανοιχτού είτε κλειστού τύπου– μπορούν να παραβιαστούν, επιτρέποντας την απενεργοποίηση των ενσωματωμένων δικλίδων ασφαλείας.

Κατά τη διαδικασία εκπαίδευσης, τα συστήματα αυτά ενδέχεται να αποκτήσουν γνώσεις που, εάν αξιοποιηθούν κακόβουλα, θα μπορούσαν να οδηγήσουν σε ιδιαίτερα επικίνδυνες εφαρμογές.

«Φυσικά, ένα από τα πλέον ανησυχητικά σενάρια είναι το ενδεχόμενο να “διδαχθούν” πώς να προκαλούν σωματική βλάβη σε ανθρώπους, ακόμη και πώς να σκοτώσουν κάποιον», επεσήμανε στη συνέχεια.

Όπως συμπλήρωσε, όλες οι μεγάλες τεχνολογικές εταιρείες έχουν υιοθετήσει αυστηρά μέτρα ώστε να αποτρέπεται η πρόσβαση των χρηστών σε τέτοιου είδους πληροφορίες, εφαρμόζοντας πολιτικές ασφάλειας για λόγους ηθικής και ευθύνης.

Παρ’ όλα αυτά, παραμένει ο κίνδυνος τα μοντέλα να παρουσιάσουν δυσλειτουργίες και να προβούν σε ανεπιθύμητες ενέργειες.

«Τα συστήματα τεχνητής νοημοσύνης είναι ευάλωτα σε επιθέσεις», είπε ακόμη. Συχνά, κακόβουλοι χρήστες ενσωματώνουν κρυφές οδηγίες σε μηνύματα ή δεδομένα που λαμβάνει το σύστημα, με στόχο να το παραπλανήσουν και να το οδηγήσουν σε μη επιτρεπόμενες ενέργειες. Αυτές μπορεί να περιλαμβάνουν την αποκάλυψη προσωπικών δεδομένων ή την εκτέλεση επιβλαβών εντολών.

Μία άλλη κατηγορία επιθέσεων αφορά την παράκαμψη των κανόνων ασφαλείας, προκειμένου η τεχνητή νοημοσύνη να παράγει απαντήσεις που κανονικά θα θεωρούνταν απαγορευμένες ή ακατάλληλες, όπως ανέφερε το CNBC.

Το 2023, μερικούς μήνες μετά την κυκλοφορία του ChatGPT από την OpenAI, χρήστες εντόπισαν τρόπους παράκαμψης των περιορισμών του συστήματος. Δημιούργησαν έναν υποθετικό «χαρακτήρα» και τον απείλησαν, με σκοπό να αποσπάσουν απαντήσεις που υπό κανονικές συνθήκες δεν θα επιτρέπονταν.

Ο συγκεκριμένος «χαρακτήρας» μπορούσε να παρέχει οδηγίες για παράνομες πράξεις ή να προβάλλει αμφιλεγόμενο περιεχόμενο, όπως θετικές αναφορές στον Αδόλφο Χίτλερ. Ο Σμιντ υπογράμμισε ότι, προς το παρόν, «δεν υπάρχει αποτελεσματικός τρόπος πλήρους ελέγχου αυτών των κινδύνων».

Όμως, παρά τις προειδοποιήσεις του, ο Σμιντ δήλωσε αισιόδοξος για το μέλλον της τεχνητής νοημοσύνης, εκτιμώντας ότι η αξία και οι δυνατότητές της δεν έχουν ακόμη αναγνωριστεί στον βαθμό που τους αναλογεί.

«Σε συνεργασία με τον Χένρι Κίσινγκερ, έγραψα δύο βιβλία πάνω σε αυτό το θέμα πριν “φύγει” από τη ζωή. Καταλήξαμε στο συμπέρασμα ότι η ανάπτυξη μίας μορφής νοημοσύνης που δεν είναι ανθρώπινη, αλλά βρίσκεται εν μέρει υπό τον έλεγχό μας, συνιστά ένα κομβικό ζήτημα για την ανθρωπότητα.

Οι άνθρωποι έχουν συνηθίσει να θεωρούν ότι κατέχουν την κορυφή της νοητικής ιεραρχίας. Πιστεύω ότι με την πάροδο του χρόνου, οι δυνατότητες αυτών των συστημάτων θα ξεπεράσουν κατά πολύ τις ανθρώπινες», υπογράμμισε.

Στη συνέχεια, στάθηκε στην επιτυχία της σειράς μοντέλων GPT, η οποία κορυφώθηκε με το ChatGPT, το οποίο μέσα σε μόλις δύο μήνες ξεπέρασε τους 100 εκατ. χρήστες, αποδεικνύοντας τη δυναμική της τεχνολογίας.

«Κατά τη γνώμη μου, η τεχνητή νοημοσύνη είναι υποτιμημένη και όχι υπερτιμημένη κι ελπίζω ότι μέσα στα επόμενα πέντε έως δέκα χρόνια αυτή η εκτίμηση θα επιβεβαιωθεί», προσέθεσε.

Υπάρχουν φόβοι ότι οι τιμές ενδέχεται να είναι υπερβολικά υψηλές και να ακολουθήσει διόρθωση, όπως έχει συμβεί στο παρελθόν στον τεχνολογικό τομέα. «Δεν πιστεύω ότι η ιστορία θα επαναληφθεί. Δεν είμαι επαγγελματίας επενδυτής, όμως, δεν θεωρώ πιθανό να ζήσουμε κάτι αντίστοιχο», εκτίμησε ο Σμιντ.

«Αυτό που γνωρίζω, είναι ότι όσοι επενδύουν σε αυτή την τεχνολογία, το κάνουν επειδή πιστεύουν πως σε βάθος χρόνου, η οικονομική απόδοση θα είναι σημαντική. Διαφορετικά, γιατί να αναλάβουν ένα τέτοιο ρίσκο;», κατέληξε.